“半夜刷直播被吓哭” ,快手被色情暴力内容攻陷2小时后下载量反而激增才是最恐怖的

2025年,互联网一次又一次证明了,早已成为基础设施的巨型平台比我们想象的更脆弱。

10月,控制着全球1/3公共云计算市场的亚马逊AWS服务器宕机,当天不仅亚马逊网站瘫痪了9个小时,Zoom、星巴克等网站也出现中断,“数百万美国人断网的一天”。12月4日,“支付宝崩了”再次登上热搜,同时淘宝和闲鱼也出现页面异常。这是10月来支付宝的第三次故障,平均每月一次。

距离新年只剩一周之际,互联网的内容世界也崩塌了一角。

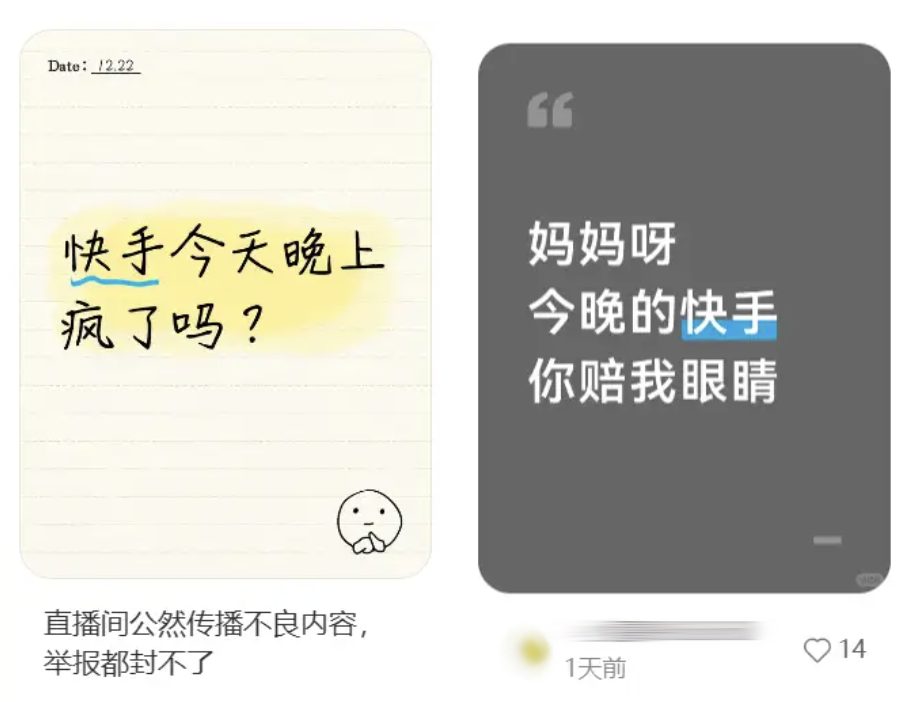

12月22日晚,快手直播的首页突然涌现出大量播放着色情、血腥、暴力内容的直播间。

约10点左右,大量快手用户目睹了这些直播。直到23日凌晨00:30左右,快手才紧急关停了直播功能。在直播被关停时,已经有单场直播观看人数超过了5万人。

快手在公开声明里,将这次事故归因于“平台遭到黑灰产攻击”。攻击者如何绕过安保机制,又为什么要以违规内容直播的形式攻击,网络上有诸多揣测,但目前快手官方还没有给出更详尽的解释。

“唯一能确定的是,快手不只是受害者。”

晚上10点,正是许多人点开短视频App,休息娱乐的高峰期。

有用户描述,22日晚上,她正在快手上刷着美食直播,下一秒划出来的却是露骨的色情画面。在她的首页上,平常看的带货、吃播都不见了,色情内容占领了多个直播间,“一划全是”。她感到不适,赶紧退出了直播间。

“还好退得早,听说之后还有人看到血腥、解剖的内容。”

集中上线后,这些直播间的观看人数飞涨。有的直播间观看人数超5万,这也助推了这些内容被推向更多的人。色情、暴力内容的直播不断涌现,有人说自己的首页“一度刷不出其他内容”“往下划10次都是涉黄内容”。

直到第二天凌晨00:30,快手才下架了全部直播频道——“无差别关停”被认为是互联网平台最高级别的应急处理措施。

大量用户见证了这场长达2个半小时的混乱。直播的发布者既有刚注册的新账号,也有曾经发过视频的老账号——这些账号被认为是长久没被使用的“僵尸号”。有人甚至看到了一个账号显示距离自己只有500米。

有人尝试举报这些直播间,但无果。当天凌晨,北京公安局海淀分局对《红星新闻》表示,他们已经接到了多个快手直播相关的群众报案。

23日00:45左右,快手的直播功能基本恢复正常。

随后一早,快手官方回应这次事件称“平台遭到灰黑产攻击,已紧急处理修复”。并表示快手“强烈谴责黑灰产的违法犯罪行为”,已就上述事宜向公安机关报警并向相关部门报告。

在互联网上,网友们的第一反应是将事故归因于快手的“审核失灵”,“当晚审核员都集体睡着了吗”的质疑层出不穷。这也是在看到违规内容时,多数人的直接印象——审核机制,无论是算法、AI还是人工,没能在海量的信息流里“捉住”那些“本不应该出现”的内容。

可为什么捉不住?

“快手惊魂夜”发生后,迅速成为舆论焦点,多名信息安全专家在网络上公开发表了自己对这次事件经过的看法。

第一步是绕过审核。一个共同的观点是,黑灰产在制造这场混乱时使用了自动化攻击,利用海量账号集中开播,导致平台“执行封禁”的能力被摧毁了,直播账号的数量太大,以至于“突破了审核防守的极限”。

其次是实名认证问题。直播需要实名认证,而攻击者被认为是通过盗号获得已实名的用户账户、或大批注册虚拟手机号等方式,“绕开了实名认证系统获得实名权限”。

最后,这些直播间不仅开播,还出现了在无数人的“首页”,这意味着推荐机制也参与其中。这些直播间随后被推荐给了大量用户,这可能是由于攻击者“拿到推流做加密流量”,也或许是“用户访问量激增”,激发了算法的推荐机制。

“攻击”选择的时间点,也被认为是这场混乱影响广泛的原因之一:晚10点是用户大量登入的“平台负载水位高点”,也是人工审核换班期,人力最薄弱、应急响应速度下降。

这场危机之所以让快手“猝不及防”,可能的技术背景是,AI的快速发展让发起类似攻击的门槛降到了极低,大规模、高频次的攻击实现了“全面自动化”。11月,由全球领先的AI实验室Anthropic发布的报告证实,今年9月,一场“高度复杂”的攻击活动已由 AI 彻底主导,每场攻击中人类仅需参与4-6次关键决策。

但无论是哪种可能性,都表明快手从直播实名认证,到内容审核,再到推流机制,都存在潜在的漏洞。

漏洞分布在各个环节,意味着快手也本该有多次机会发现问题和阻止攻击。“比如业务侧方面,以前的僵尸用户突然活跃起来了却没有预警,这就是问题。”一位网络安全资深从业者对《虎嗅》分析道。

无论攻击的手段再怎么高明,无可否认的是的,任何内容所造成的影响大小都和“被看到”和“被传播”的时间长短直接相关。在这场持续了超过2个小时的混乱中,一些内容被截图、录屏,在社交媒体上再次被分享。

作为国内的头部互联网大厂,快手的解决速度超出了很多人的预料,因此也被业内质疑“决策链路冗长,缺乏紧急情况下快速响应的机制”。

但是,比起“遭到攻击”背后复杂的技术博弈,快手事故中引起更广泛忧虑的,或许是攻击者所使用的内容——色情、暴力、血腥。当大量未经过滤的极端内容出现在一个日活跃用户超过4亿的短视频平台的直播页面,遭受冲击的往往是最毫无防备的用户,其中就包括未成年用户。

有人在自己的社交媒体上分享,当天晚上自己的未成年表弟在快手上刷直播,意外看到了极其血腥的直播间内容,哭着给自己打电话,因为“不敢告诉父母”。

2023年《第5次全国未成年人互联网使用情况调查报告》显示,经常看短视频的未成年网民比例已经从2018年的40.5%增长至2022年的54.1%,“短视频成为未成年人获取信息的重要渠道。”

图源:《网络谜踪》

在这次“攻击”因快手短暂下架直播功能而终止之后,更普遍的担忧则源于这样的事实:短视频平台里的色情、极端、伤害性内容并不只是出现在了这一次大规模的“黑灰产攻击”中。

作为国内最大的短视频平台之一,快手的不良内容低龄化趋势在近两年成为争议的焦点。

诸如“05年孕妇三胎日常”“幼辣风”“厕所文化”一度在快手上层出不穷,一些视频达到了千万级播放量。由此延伸出“慢脚文化”(慢脚对应快手)——以未成年人为演绎主角的一系列擦边、暴力、猎奇的短视频,曾在快手上盛行。

快手也因为违规内容多次受到处罚。去年4月,“低龄妈妈”视频在快手走红引发批评,快手被广电总局约谈。11月底,国家网络安全通报中心发布通告称,快手存在对法律、行政法规禁止发布或者传输的信息未及时处置,以及落实青少年模式不到位等情况,导致违法信息扩散,危害未成年人身心健康,对快手公司采取警告处罚。

问题当然不只是快手的。2021年的扫黄打非行动中,抖音因存在传播淫秽色情低俗信息行为,被处以顶格罚款的行政处罚。而在b站平台上,“深夜里能看到的擦边直播更多”,长期以来被用户们当成一种心照不宣的“默认规则”。

这种内容生态的庞大和持续,可以从各个平台的“治理报告”中部分窥见。

快手发布的《2024快手社区治理报告》显示,去年一年,快手清理谣言视频51万余条,封禁谣言账号3万余个。网络暴力更是“违规内容”的重灾区,去年快手拦截网暴信息388万余条,清理网暴信息24.3万余条。

“黑灰产”也并不是第一次出现在快手的治理中。快手去年日均识别封禁网络水军、黑产机器人等账号22.5万个,拦截作弊请求超1亿次。

在刚刚过去的一个月,抖音宣布平台清除了涉及未成年人违规内容20.2万条,其中包括“利用未成年人形象不当牟利”“涉未成年人色情低俗”等。

图源:《混沌少年时》

而这些仅仅是被发现、被拦截的部分。

抖音、快手等主流短视频平台都采取双重审核的机制。抖音在今年4月公开解释了他们的审核机制:平台会先使用机器对用户上传的内容进行识别、过滤,被判断有高危特征的内容会被直接拦截。如果内容“未命中高危特征但模型判断有问题”,会再采取一轮人工审核。但如果机器判定内容出问题概率较低,内容就会获得基础流量,进入下一环节。

值得注意的是,直播的内容审核比短视频难得多。“短视频是先审后发,直播是边播边审,在实时性方面更难保证”,一位参与了抖音团队内容审核大模型研发的员工向《氢商业》透露。

AI早已成为视频平台内容审核的重要参与者,AI会根据历史违规数据训练好的模型,对色情暴力、敏感词违禁词等常见违规现象进行判定。早在2018年,抖音就开始运用人工智能辅助内容审核。现在很多场景里已经在用更细分、专业的小模型进行审核,直播大模型则“正在训练中”。

总体而言,目前用于直播审核的大模型,还远不如短视频审核的大模型成熟,上述员工表示。

审核和流量的天平,在直播间和短视频中并不相同:直播审核、封禁的难度更大,但直播业态对快手的流量却至关重要。2020年时,快手两亿多的日活中有一半是直播用户。当时,快手科技副总裁余敬中直言,直播是快手的最大优势。

如果一个视频或直播在发布之后被用户举报,则会通过人工复审等方式进行下架。在互联网上,构建内容秩序的最后一道关卡的,依旧是人。

审核员的岗位在大厂中长期处于“缺人”的状态。在4月份被约谈后,快手的一则招聘信息显示,他们计划扩招3000名审核人员,将原本2000人的审核团队扩充到5000人,“党员团员优先”。

各大平台的内容审核员中,很大一部分是外包岗位。据南都大数据研究院2022年的调查,快手超过一半的审核相关岗位分布在成都、武汉、天津、哈尔滨等地。“二三线城市为主”的地域分布对应着更低的用工成本,内容审核员的工资区间大多分布在4000到8000之间,“从业者以毕业生、一到三年工作经验的人群、大专或以上学历为主,没有专业限制”。

很多审核员需要承受频繁的夜班,近12小时的工作时长。长期面对色情、暴力、凶杀等极端内容,也让很多人长期承受心理压力,一些人因此患上PTSD(创伤后精神紧张性障碍)。

而高度依赖于“人”的内容审核机制,一定程度上意味着,互联网上每一秒都在更新、变化的内容秩序很难做到真正的“稳定安全”,甚至相当脆弱。

内容治理的难度,除了“黑灰产”们愈发先进的网络技术,还有人性驱动的“算法惯性”存在。讽刺的是,在遭遇攻击的当晚,快手App的下载次数大涨。23日,快手在苹果应用商店免费榜单的排名升至第二名。事故结束的第二天,依然有人在社交媒体上发帖,“遗憾没赶上前一天晚上快手上的色情直播”。平台在流量和内容安全之间总是存在“两难”,但潜在的利益同时也表明平台在其中承担的不可推卸的责任。

这种“算法惯性”还意味着,“如果你给互联网开一个口子,它就会被垃圾填满”。

“互联网公司制定的具体规则几乎都是不被人所知的,不透明的规则使科技公司成为最终仲裁者,这意味着他们可以随时更改规则,且无需对任何人负责,这种关系非常不平衡”,长期关注社交媒体审核机制的美国加州大学洛杉矶分校助理教授莎拉·罗伯茨在和《界面文化》的访谈中总结道。

AI逐渐取代了部分人类审核员的工作,但这并不意味着内容审核离“人”越来越远,反而审核越来越需要人类把关。

类似ChatGPT这样新工具的开发,都需要庞大的工人队伍辅助、有人必须收集AI训练数据,有人必须审核算法,有人必须处理误判的问题,“我们只是在改变人类审核的时间点”,莎拉·罗伯茨说。

于是问题最终还是回到了,互联网公司和人选择了什么。一家头部互联网公司的前金融业务算法总监曾将平台算法长期存在的问题总结为商业目标导致的“系统冷漠”。这种冷漠包含平台获取流量的人之间的博弈,以及算法设定者——同时也是大厂员工,面临的收益导向的KPI压力,“员工们的优化目标是点击,存留,而不是一则信息是否健康、属实。”

这种选择性,还体现在公司如何决定成本分配。“网络安全作为不产生直接效益的部门,一旦公司开始收缩则很可能被优先裁掉”,《虎嗅》的报道指出。

有网络安全从业者在快手直播事故后感叹,“辛苦工作一年没出事,领导觉得你什么都没做;年底一出事,领导觉得你该担责。

在这次“快手惊魂夜”中,外界很难在短时间内知晓最终的处置和责任归因。明确的是,遭到这次事故直接影响的除了快手用户,还有大批快手的普通员工,以及刚刚拿到快手offer的毕业生——“本来很开心,现在不知道还该不该入职了”。

“牛马当久了,看到这件事的第一反应是同情:不知道多少人辛辛苦苦干一年,年终奖没了,工作也不保了。”

参考资料:

1.界面文化,《互联网审核行业将继续不可见,并以最糟糕的方式全球化 | 专访》,2023.07

2.财联社,《算法逐利 :商业自驱下的“系统冷漠”》,2024.12

3.虎嗅App,《快手不止是“受害者”,快手还没有做到的》,2025.12

4.第一财经,《打破“信息茧房”,抖音披露算法逻辑与审核机制》,2025.04

5.每日经济新闻,《快手大整改,急招3000人审核团队,党员团员优先》,2025.04

6.中国日报,《快手副总裁余敬中:直播是快手的最大优势,两亿多日活一半是直播用户》,2020.01

7.第一财经,《自动化工具还是业务层对抗?安全专家这样分析快手被攻击》,2025.12

编辑|卢力麟

作者|贾小乐

设计|胖兔

封面图源|Netflix 纪录片《监视资本主义:智能陷阱》